La inteligencia artificial (IA) ha irrumpido con fuerza en los sectores creativos, y uno de los más vulnerables es el doblaje.

Los actores que prestan su voz a personajes de ficción se enfrentan a una amenaza inédita: la posibilidad de ser reemplazados por réplicas digitales generadas sin su consentimiento. Estas voces sintéticas ya se utilizan en videojuegos, audiolibros y vídeos educativos, en ocasiones sin contar con los intérpretes originales.

Caso Françoise Cadol: una voz, una identidad

Un ejemplo emblemático es el de Françoise Cadol, actriz francesa que interpretó a Lara Croft en varias entregas de Tomb Raider. Cadol descubrió que su voz había sido imitada mediante inteligencia artificial y utilizada en un videojuego remasterizado sin autorización. La actriz interpuso una demanda contra Aspyr Media, argumentando que la voz forma parte de la identidad personal y que su uso sin consentimiento vulnera derechos fundamentales.

Tras la denuncia, la empresa se vio obligada a retirar las voces generadas por IA, marcando un precedente que ha reavivado el debate sobre la protección de los intérpretes frente al uso no autorizado de su voz.

En España, también han surgido controversias con títulos como Doom: The Dark Ages y World of Warcraft, donde se habría intentado entrenar modelos de IA con grabaciones de actores sin permiso.

¿Cómo se entrena una IA con voces humanas?

El entrenamiento de IA puede realizarse mediante dos métodos:

- Observación de obras: La IA analiza ideas y conceptos sin reproducir directamente el contenido. Este método es menos conflictivo legalmente.

- Reproducción de obras: Se introducen obras protegidas (como grabaciones de voz) directamente en la base de datos del sistema. En este caso, se puede incurrir en plagio o en la creación de obras derivadas sin autorización.

Cuando una IA se entrena con grabaciones de un actor para generar una voz sintética que imita su timbre o estilo, se entra en una zona gris legal que requiere atención urgente.

El Reglamento Europeo de IA y el Estatuto del Artista

El Reglamento Europeo de Inteligencia Artificial (RIA) establece que toda voz generada por IA que imite a una persona real debe estar claramente etiquetada. Además, el uso no autorizado puede vulnerar el derecho a la imagen, la identidad personal y la integridad profesional.

En España, el nuevo Estatuto del Artista busca actualizar la regulación vigente desde 1985 para adaptarla al entorno digital. El Sindicato de Artistas de Doblaje (Adoma) reclama que:

-

El uso de la voz para entrenar modelos de IA no se considere parte de la relación laboral.

-

Los datos vocales sean eliminados tras la producción.

-

Se reconozca una compensación justa y específica por el uso de la voz, siempre con consentimiento explícito y revocable —especialmente si se utiliza en contextos contrarios a los valores del intérprete.

Perspectiva internacional: ¿Es legal entrenar IA con voces humanas?

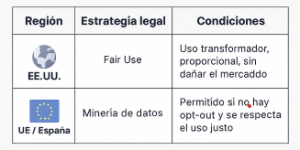

Las estrategias legales varían según la jurisdicción:

En EE.UU, el entrenamiento de IA con material protegido por derechos de autor se analiza bajo la doctrina del Fair Use (uso justo), y se analiza caso por caso.

Esta doctrina permite utilizar obras protegidas sin necesidad de autorización, siempre que se cumplan ciertos criterios y el uso se considere “transformador”, es decir, que aporte un nuevo propósito, significado o valor a la obra original.

Los tribunales evalúan el Fair Use caso por caso, considerando cuatro factores principales:

-

Propósito y naturaleza del uso: si el uso tiene un fin educativo, de investigación o transformador, pesa a favor del Fair Use.

-

Naturaleza de la obra original: cuanto más creativa o expresiva sea la obra, mayor protección recibe. Se considera si el material es principalmente factual o creativo.

-

Cantidad y sustancialidad del uso: se analiza si la cantidad del material utilizado es el necesario para el fin legitimo en relación con el trabajo original.

-

Efecto sobre el mercado potencial: si el uso perjudica económicamente al autor o sustituye su obra en el mercado, se considera infracción.

Por lo tanto, en EEUU, en el contexto del entrenamiento de IA, la clave está en determinar si analizar miles de grabaciones para extraer patrones de voz constituye un uso transformador (aprendizaje estadístico) o una reproducción no autorizada. Hasta ahora, los tribunales estadounidenses han mostrado una tendencia flexible, pero varios casos recientes —como el de Anthropic AI— están marcando los límites de lo que puede considerarse Fair Use.

Este marco fue clave en el caso de Anthropic AI, cuando la empresa fue demandada por entrenar su chatbot Claude con millones de libros pirateados. Aunque el uso fue considerado “transformativo”, el tribunal dictaminó que descargar obras de bibliotecas ilegales como LibGen constituía una infracción deliberada. El resultado fue un acuerdo histórico: Anthropic se comprometió a pagar 1.500 millones de dólares a los autores y editores afectados, además de 3.000 dólares por cada obra utilizada.

Este precedente es crucial para los actores de doblaje: demuestra que el uso ilícito de contenido protegido para entrenar IA puede ser sancionado, incluso si el resultado final no es una copia exacta.

En Europa, la Directiva introduce la figura de la minería de textos y datos permite el uso para investigación que permite usar obras para investigación o innovación si el autor no se ha opuesto expresamente (opt-out).

En el ámbito del doblaje, la minería de textos y datos adquiere una dimensión especialmente delicada. Cuando una empresa utiliza grabaciones de voz de actores para entrenar modelos de IA —con el fin de recrear timbres, acentos o estilos interpretativos— está realizando una extracción masiva de datos expresivos protegidos. Este uso solo sería lícito si el actor no se ha opuesto expresamente (opt-out) o si ha otorgado su consentimiento previo para fines comerciales. De lo contrario, se estaría vulnerando tanto los derechos de interpretación del artista (por la reproducción no autorizada de su voz) como sus derechos morales, especialmente el de integridad de su actuación.

El Reglamento Europeo de IA (RIA) refuerza esta protección al exigir que las voces generadas artificialmente estén claramente etiquetadas y que el uso de datos personales, como la voz, requiera transparencia y consentimiento informado.

¿Y las voces?

Aunque la voz no está reconocida como “obra intelectual” en sentido estricto, sí que lo son las interpretaciones realizadas, ademas de formar parte del derecho a la imagen y la identidad personal. Si una IA clona la voz de un actor sin autorización, se vulneran su derecho de interpretación, a la imagen y a la integridad profesional. El Reglamento Europeo de IA exige que las voces generadas artificialmente estén claramente etiquetadas, lo que refuerza la transparencia y permite denunciar usos no consentidos.

Este derecho de interpretación, regulado en el art. 105 de Ley de Propiedad Intelectual, otorga al intérprete el control sobre la fijación, reproducción, comunicación pública y transformación de su actuación, lo que incluye su voz como medio expresivo. Por tanto, clonar digitalmente la voz de un actor sin autorización supone una reproducción o transformación ilícita de su interpretación, con posibles responsabilidades civiles y, en algunos casos, penales. Además, junto a los derechos patrimoniales, los intérpretes también poseen derechos morales, entre ellos el de reconocimiento de su condición de artista, el derecho a la integridad de su interpretación y el derecho a oponerse a cualquier deformación, modificación o utilización no consentida que pueda perjudicar su reputación profesional.

En el contexto de la IA, estos derechos cobran una importancia crucial: una voz clonada puede alterar el tono, la intención o el sentido original de la actuación, vulnerando el derecho moral a la integridad. Así, la utilización de voces sintéticas que imitan a un actor sin su consentimiento o en contextos contrarios a su voluntad o valores constituye una infracción directa de su derecho moral y de sus derechos conexos como intérprete.

La batalla de los actores de doblaje no es contra la inteligencia artificial, sino contra la falta de consentimiento y reconocimiento. La IA ofrece oportunidades inmensas, pero también exige una legislación ágil y garantista, que asegure que la innovación no se construya a costa de la identidad humana.

Casos como el de Françoise Cadol, junto con marcos como el Estatuto del Artista y el Reglamento Europeo de IA, marcan el inicio de una nueva etapa: aquella en la que la tecnología y los derechos fundamentales deben coexistir en la era digital.